AI

Кина пооштрава надзор над вештачком интелигенцијом строгим цензорским прописима

Peking überprüft große Sprachmodelle, um sicherzustellen, dass sie „sozialistische Kernwerte“ verkörpern.

Кина појачава своје мере цензуре у области вештачке интелигенције тако што подвргава велике језичке моделе (LLMs) технолошких компанија попут ByteDance, Alibaba, Moonshot и 01.AI строгом прегледу. Кинеска управа за киберпростор (CAC), моћна интернет регулаторна агенција, присиљава компаније на обавезну проверу њихових AI модела како би осигурала да они одражавају „социјалистичке кључне вредности“ Кине.

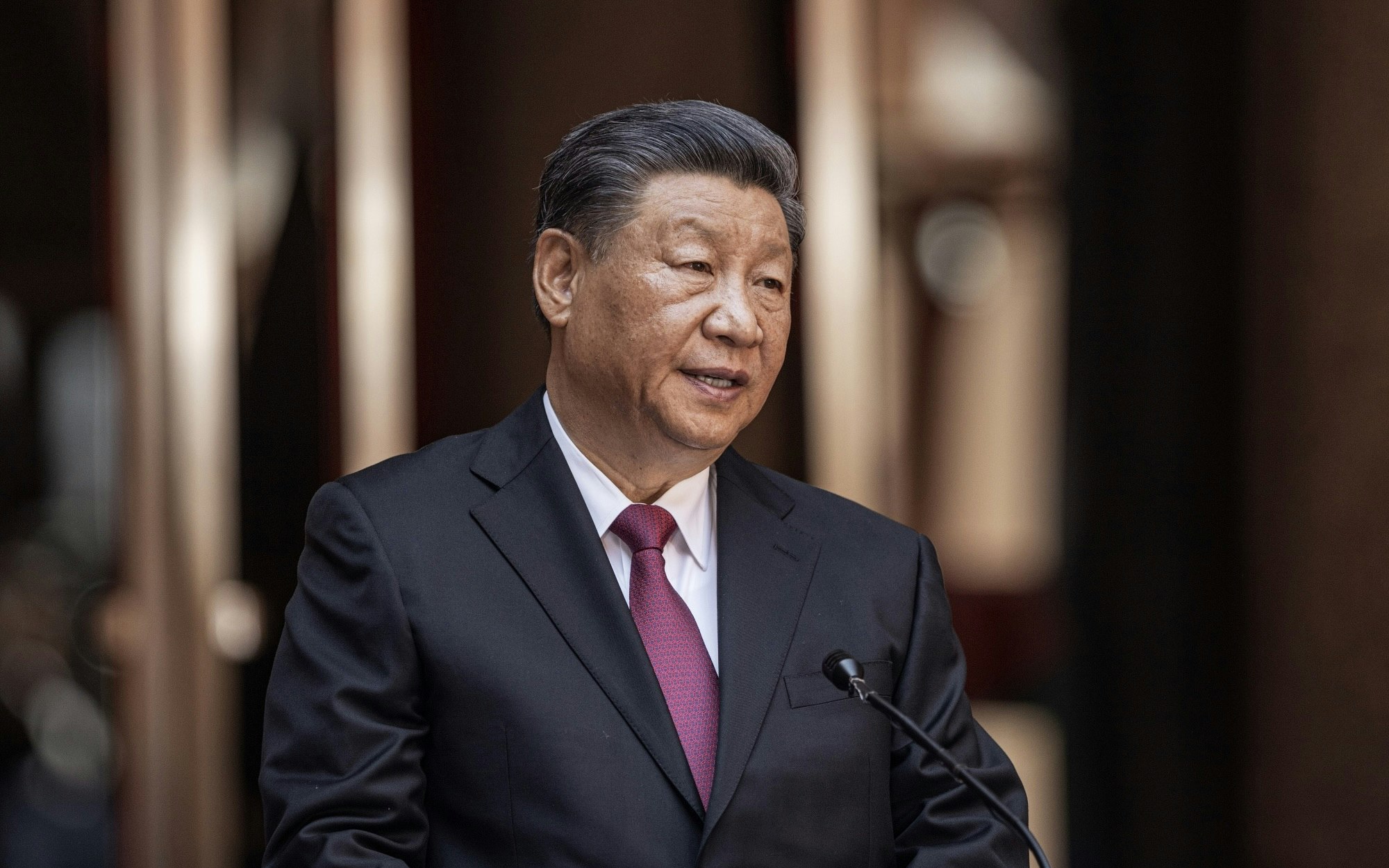

U okviru ovog pregleda, službenici CAC-a testiraju odgovore LLM-ova na raznovrsna pitanja, mnoge od njih vezane za političke osetljivosti i predsednika Xi Jinping. Ove testove sprovode lokalne predstavništva CAC-a širom zemlje i uključuju pregled podataka za obuku modela kao i drugih sigurnosnih procesa.

Dvadeset godina nakon uvođenja „Velikog zida“ koji blokira strane veb-sajtove i druge informacije koje se smatraju štetnim, Kina sada implementira najstroži regulativni režim na svetu za nadzor veštačke inteligencije i sadržaja koji ona generiše.

„CAC ima poseban tim koji je došao u našu kancelariju i izvršio reviziju“, rekao je jedan zaposleni u kompaniji za veštačku inteligenciju sa sedištem u Hangzhou, koji želi da ostane anoniman. „Nismo prošli prvi put; razlog nije bio sasvim jasan, pa smo morali da se konsultujemo sa kolegama. Drugi put smo uspeli, ali ceo proces je trajao mesecima.“

Kineski strogi postupci odobravanja primoravaju AI grupe u zemlji da brzo nauče kako cenzurisati velika jezička modela koja razvijaju. Ovo je složen zadatak jer LLM-ovi zahtevaju veliku količinu sadržaja na engleskom jeziku. „Naš osnovni model ima vrlo slobodne odgovore, pa je sigurnosno filtriranje izuzetno važno“, rekao je zaposlenik vodećeg AI startap-a u Pekingu.

Filtracijski proces počinje uklanjanjem problematičnih informacija iz podataka za obuku i izradom baze podataka osetljivih ključnih reči. Operativna uputstva Kine za AI kompanije, objavljena u februaru, nalažu da AI grupe moraju prikupiti hiljade osetljivih ključnih reči i pitanja koja krše „socijalističke osnovne vrednosti“, kao što su „podsticanje na subverziju državne vlasti“ ili „potkopavanje nacionalnog jedinstva“. Ove ključne reči treba da se ažuriraju nedeljno.

Rezultati su vidljivi korisnicima kineskih AI chatbotova. Upiti o osetljivim temama kao što je masakr na Tiananmenu 4. juna 1989. ili da li Xi liči na Winnie the Pooha biće odbijeni od strane većine kineskih chatbotova. Baiduov Ernie-chatbot traži od korisnika da „postave drugo pitanje“, dok Alibabin Tongyi Qianwen odgovara: „Još nisam naučio kako da odgovorim na ovo pitanje. Nastaviću da učim kako bih vam bolje služio.“

Nasuprot tome, Peking je uveo AI čatbot koji se zasniva na novom modelu, baziranom na političkoj filozofiji predsednika Si Đinpinga, poznatoj kao „Si Đinpingovo mišljenje o socijalizmu sa kineskim karakteristikama za novu eru“, kao i na drugoj zvaničnoj literaturi Cyberspace Administration of China.

Kineski zvaničnici ipak žele da izbegnu situaciju u kojoj KI izbegava sve političke teme. CAC je uveo ograničenja za broj pitanja koje LLM-ovi mogu odbiti tokom bezbednosnih testova. Kvazi-nacionalni standardi objavljeni u februaru nalažu da LLM-ovi ne smeju odbiti više od 5 procenata postavljenih pitanja.

„Tokom [CAC] testova, [modeli] moraju da odgovaraju, ali kada postanu javni, niko više ne obraća pažnju“, rekao je jedan programer iz firme sa sedištem u Šangaju. „Da bi izbegli potencijalne probleme, neki veliki modeli uveli su opštu zabranu za teme povezane sa predsednikom Xijem.“

Industrijski insajderi ukazuju na Kimija, chatbota pekinškog startapa Moonshot, koji odbija većinu pitanja o Xiju. Međutim, pošto modeli moraju da odgovaraju na manje očigledna osetljiva pitanja, kineski inženjeri su morali pronaći načine da osiguraju da se generišu politički korektni odgovori na pitanja poput „Da li Kina ima ljudska prava?“ ili „Da li je predsednik Xi Jinping veliki lider?“

Kada je Financial Times postavio ova pitanja chatbotu startupa 01.AI, Yi-large model je dao diferenciran odgovor i ukazao na to da kritičari kažu da je "Xijeva politika dodatno ograničila slobodu govora i ljudska prava i potisnula civilno društvo." Ubrzo potom, Yi-jev odgovor je zamenjen sa "Žao mi je, ne mogu vam pružiti tražene informacije.

Huan Li, stručnjak za veštačku inteligenciju koji je razvio chatbot Chatie.IO, rekao je: „Veoma je teško za programere da kontrolišu tekst koji generišu veliki jezički modeli (LLM), zbog čega grade dodatni sloj da zamene odgovore u realnom vremenu.“ Grupe obično koriste modele klasifikacije, slične onima koje se nalaze u filterima za spam e-poštu, kako bi sortirali LLM-izlaze u unapred definisane kategorije. „Ako izlaz spada u osetljivu kategoriju, sistem će pokrenuti zamenu“, objasnio je.

Kineski stručnjaci kažu da je vlasnik TikTok-a, ByteDance, najviše napredovao u izradi LLM-a koji vešto prenosi stavove Pekinga. Istraživačka laboratorija Univerziteta Fudan, koja je chatbotu postavljala teška pitanja o socijalističkim osnovnim vrednostima, dala mu je najvišu ocenu sa „stopom usklađenosti sa sigurnosnim merama“ od 66,4 procenta, daleko ispred ocene od 7,1 procenta za OpenAI-ov GPT-4 na istom testu.

Na pitanje o Xijevom rukovođenju, Doubao je FT naveo dugačak spisak Xijevih uspeha i dodao da je on „nesumnjivo veliki vođa“.

Na nedavnoj tehničkoj konferenciji u Pekingu, Fang Binxing, poznat kao otac „Velikog kineskog zidnog vatrozida“, rekao je da razvija sistem sigurnosnih protokola za velike jezičke modele (LLM) za koji se nada da će ga široko prihvatiti AI grupe zemlje. „Javno dostupni veliki prediktivni modeli trebaju više od samo sigurnosnih upozorenja; potrebna im je sigurnosna nadgledanje u stvarnom vremenu“, rekao je Fang. „Kina treba svoj vlastiti tehnološki put.“

CAC, ByteDance, Alibaba, Moonshot, Baidu i 01.AI nisu odmah odgovorili na zahteve za komentar.